L’auto-hébergement c’est un peu le mot fourre-tout pour expliquer qu’on va gérer un service chez soi plutôt que de le mettre chez un prestataire. Quelques rappels nécessaires sur ce qu’est le web, c’est-à-dire l’ordinateur de quelqu’un d’autre.

Comprendre ce qu’est le cloud, le web en général

Le site restez-curieux est accessible partout depuis l’internet. De façon très schématique, lorsque vous tapez dans la barre d’adresse, restez-curieux.ovh, on va interroger un serveur dit DNS qui va savoir que restez-curieux.ovh se trouve sur un serveur bien identifié. Mais c’est quoi un serveur ? Un serveur, c’est tout simplement un ordinateur. Alors effectivement, un ordinateur, c’est schématique, on va plutôt parler de data center pour des tas et des d’ordinateurs dédiés au stockage.

Comme on peut le voir, il s’agit de machines qui sont bien physiques et avec elles les problèmes inhérents. Ces machines sont dans un pays, elles sont gérées par quelqu’un, le cloud, le web, c’est l’ordinateur de quelqu’un d’autre. Se posent alors de nombreuses questions quant à la personne qui gère ces machines.

- Est-ce que le prestataire est compétent ? Une compétence qui va des performances des machines en passant par leur sécurisation. Une sécurité qui n’est pas que logiciel, mais qui est aussi matériel. On se rappelle du data center de Strasbourg d’OVH qui est parti en fumée. Plus de 3.6 millions de sites touchés, des mails, des infrastructures de sociétés fonctionnant en ligne totalement paralysées. Nous sommes face à une faute professionnelle puisque OVH avait mis les sauvegardes au même endroit que le data center, il aurait fallu que physiquement les deux endroits soient différents.

- Est-ce que le prestataire est indépendant de l’état ? Le réseau social Tiktok est d’origine chinoise, on sait que les entreprises chinoises collaborent avec le gouvernement, héberger des données en Chine, c’est se soumettre au gouvernement chinois. C’est la raison pour laquelle Huawei s’est retrouvée bannie des terres et des services américains. La place économique grandissante de la société chinoise est peut-être la raison officieuse, mais l’espionnage Chinois reste une réalité. Pour les USA ce n’est pas mieux, si on parle aujourd’hui de souveraineté c’est parce que les USA ne sont plus nos alliés. Avec des Européens qui utilisent des produits américains comme ceux de Microsoft, jusqu’à l’armée parfois, il est aisé de récupérer des données stratégiques.

Ainsi, utiliser le cloud pour ses données personnelles, utiliser des services en ligne ou même héberger son site, c’est technique, mais aussi politique. L’idée d’héberger alors ces services par soi-même fait son chemin.

Pourquoi je n’hébergerai jamais restez-curieux par moi-même ?

C’est une idée que je n’ai jamais eue et que je n’aurais jamais. Je viens d’évoquer plus haut, le fait qu’on faisait appel à des professionnels de l’hébergement. Au moment où j’écris ces lignes, restez-curieux est hébergé chez le prestataire de service o2switch. On notera que je réponds au besoin politique et technique. Héberger un site internet, c’est donc l’avoir sur un PC accessible à tout le monde. C’est un métier. Il faut sécuriser la machine, être au courant des dernières normes de sécurité, faire les mises à jour. Je suis dans la situation de l’automobiliste qui confie sa voiture à un garage. Ce qui m’intéresse, c’est de conduire la voiture, pas de l’entretenir. Restez-curieux, c’est un site qui compte des millions de pages vues par an, il y a des attaques réalisées de façon récurrente sur le WordPress, je confie cette sécurité à d’autres.

Je réponds au problème politique. o2switch a été racheté par un grand groupe international, mais les serveurs et les services sont hébergés en France du côté de Clermont-Ferrand.

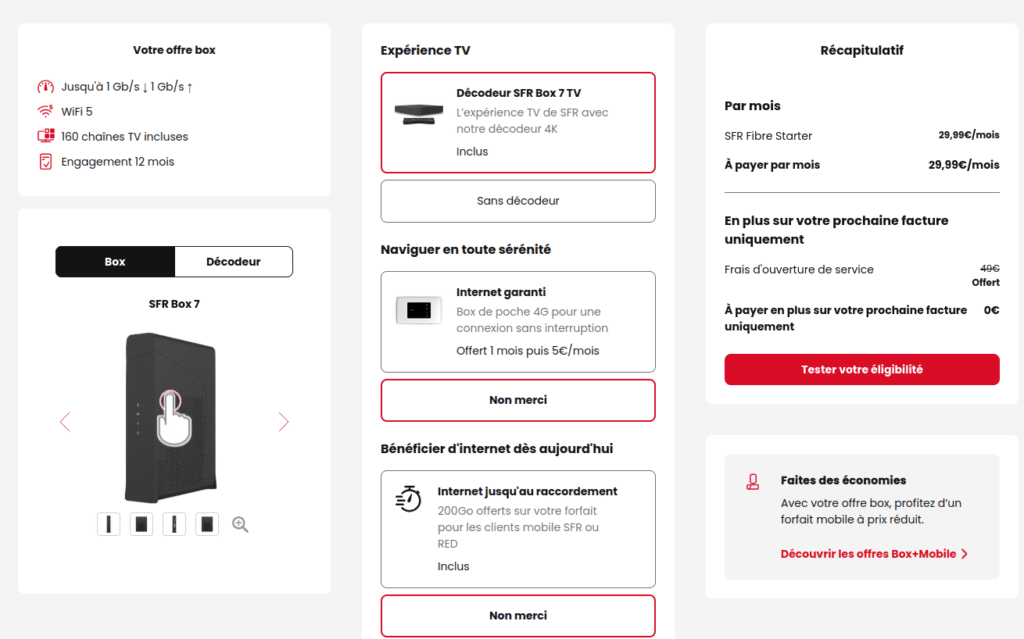

Enfin dernier critère et pas des moindres. J’aurais toutes les capacités pour gérer le site, j’aurais la machine adéquate pour supporter la charge, j’ai la fibre optique depuis mars 2025 et j’ai dû avoir 10 jours d’interruption de service. Pour un site qui doit être accessible en permanence en ligne, ce n’est pas une riche idée.

Yunohost pour tenter l’auto-hébergement

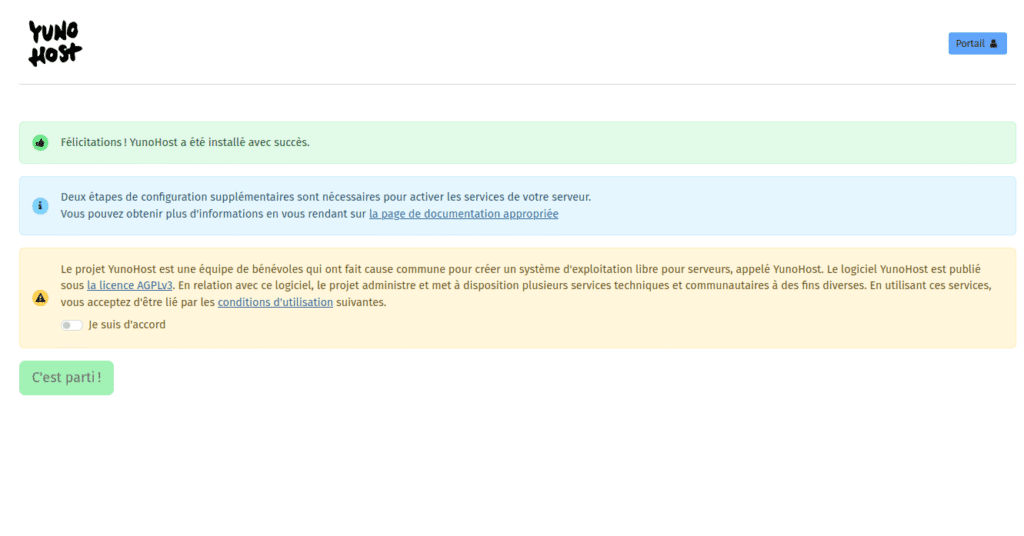

Comme je l’expliquais dans mon billet sur Linux, il existe des distributions pour tout faire. Yunohost est une distribution qui facilite l’auto-hébergement. C’est une base Debian qui va non seulement vous proposer d’installer facilement des logiciels dédiés pour le web, mais aussi sécuriser l’ensemble. Il suffit donc d’une machine assez ancienne puisque la documentation préconise seulement 512 Mo de RAM pour 16 Go de stockage. Je suis beaucoup moins optimiste parce que certaines applications web sont quand même particulièrement gourmandes à faire tourner, je pense à Nextcloud qu’on verra plus loin. L’installation se fait de façon triviale et automatique. Ce qui est important, c’est de noter l’adresse IP dans le second écran. On fait la suite de l’installation en saisissant l’adresse donnée depuis navigateur pour accéder à la suite de l’installation et de configurer le nom de l’utilisateur.

Comme on peut le voir dans les écrans ci-dessous, l’interface est agréable, simple et la masse d’applications est conséquente, on peut même faire sa propre instance Mastodon.

En moins de trente minutes, on peut déployer un serveur sécurisé avec les applications de son choix. Il s’agit pourtant d’une solution que je ne conseillerai pas dans le cas public. Entendons-nous bien. Quand bien même, vous avez un petit serveur à usage privé, à partir du moment où il est sur le net, il est public. Le risque est donc loin d’être nul. Il y a toutefois une grosse différence entre associer une url connue comme un site internet et une url qui n’est pas diffusée de façon large. Je recommande donc Yunohost dans un cadre « fermé » et pas pour une publication de masse.

Se pose aussi un autre problème, celui du contrôle. Ici, vous faites totalement confiance aux développeurs de la distribution comme vous faites confiance à votre prestataire de service. Vous vous contentez d’être simplement consommateur sans savoir ce qui se passe sous le capot.

Se pose encore deux problèmes pour ma part. Yunohost est riche, et permet de vraiment tout faire. On peut par exemple prendre en charge les adresses mails avec un dépôt de nom de domaine. On évite ainsi les classiques adresses Gmail ou Outlook chez les GAFAM. Cette souveraineté à tout de même un prix, votre compétence, votre vie. Si vous avez fait le choix de prendre en charge toute votre famille, que s’accumulent des mails importants, ou l’importance de ce mail associé à des services bancaires ou du quotidien, en cas de décès, vous laissez tout le monde dans l’embarras. De la même manière si la machine crashe de façon fatale, vous prenez le risque de perdre des données importantes.

J’aurais envie de synthétiser ceci de manière simple, l’auto-hébergement c’est bien pour jouer, pour ce qui est futile, volatile ou qui ne concerne que vous. C’est un risque que vous pouvez prendre, mais ne le faites pas assumer à d’autres.

Un serveur plutôt tourné vers l’intérieur avec OpenMediavault.

À y réfléchir, les services à héberger avec un accès extérieur sont pour ma part trop précieux pour m’essayer à les héberger moi-même. Mon site internet ou encore mes différentes adresses mails. Un serveur pourtant peut avoir du sens à domicile notamment pour réaliser des sauvegardes. Il existe des distributions dédiées qui visent à remplacer un NAS.

NAS est l’acronyme de Network Attached Storage. Il s’agit simplement d’un disque dur externe qui est accessible non pas par l’USB, mais par le réseau. On a l’habitude de voir ce type de produits dans le commerce.

Ici deux modèles de NAS « grands publics » on est sur des tarifs qui vont osciller entre 150 € pour les modèles les plus basiques à plusieurs milliers d’euros pour les modèles les plus complexes. Il faudra rajouter à cela le prix des disques durs et éventuellement certains services qui peuvent être payants.

Ici la présence de plusieurs disques est en lien avec la duplication des données. Si le premier disque venait à « casser » toutes les données sont sauvegardées sur le second disque. Avec quatre disques la duplication est encore plus importante. Le problème des NAS si ce n’est le prix, c’est le logiciel intégré à l’intérieur qui peut être, lui aussi, victime d’obsolescence programmée au point de devenir inutilisable. Par exemple, on a vu il y a quelques années l’abandon du protocole SAMBA 1, le protocole de communication de Windows, car devenu trop dangereux d’un point de vue sécurité. Comme les vieux NAS utilisaient ce protocole, les utilisateurs ne pouvaient plus accéder à leurs données. On peut dire que cela se compte en années, qu’on peut changer une machine qui a été bien amortie, mais c’est alors rentrer dans les démarches de type Microsoft. Pourquoi changer un appareil quand il fonctionne et qu’on est satisfait de son fonctionnement ?

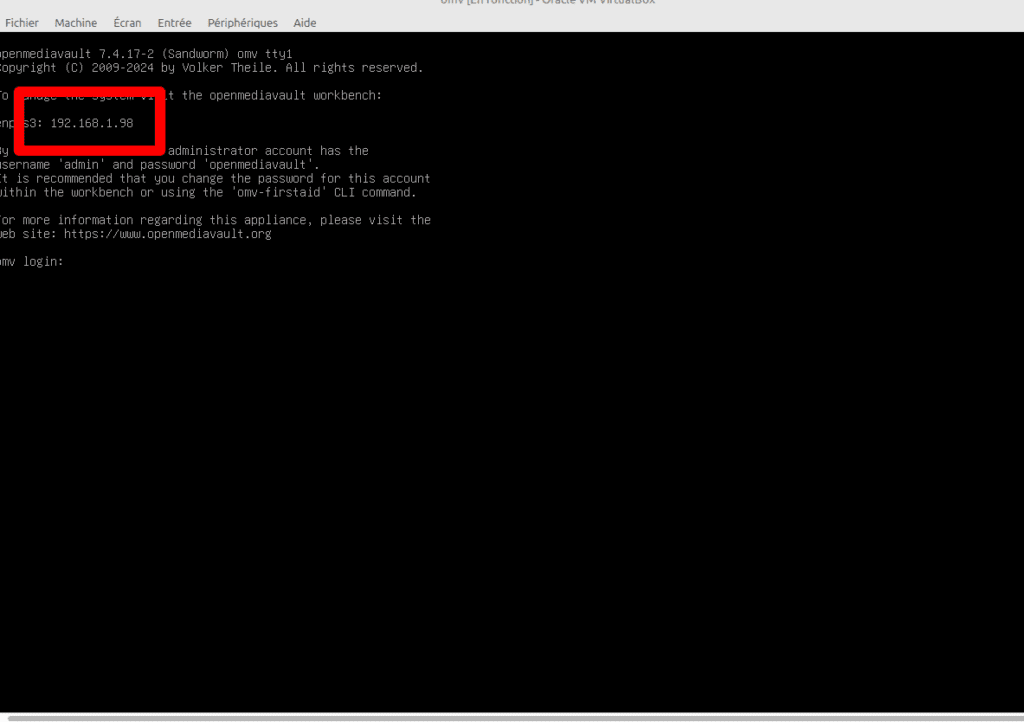

OpenMediavault est une distribution qui a vocation à transformer votre ordinateur en NAS. À l’instar de toute distribution Linux, c’est intéressant puisque le logiciel est « immortel » (le projet est quand même ancien), on peut pousser jusqu’à la mort de la machine et conserver même l’installation. Pour avoir du sens, il faut un PC avec plusieurs disques durs pour pouvoir profiter des avantages du RAID. L’installation est triviale, parce qu’il s’agit d’une base Debian.

Le seul écran important c’est le suivant, à l’instar de Yunohost qui permet de passer en mode passerelle depuis son ordinateur.

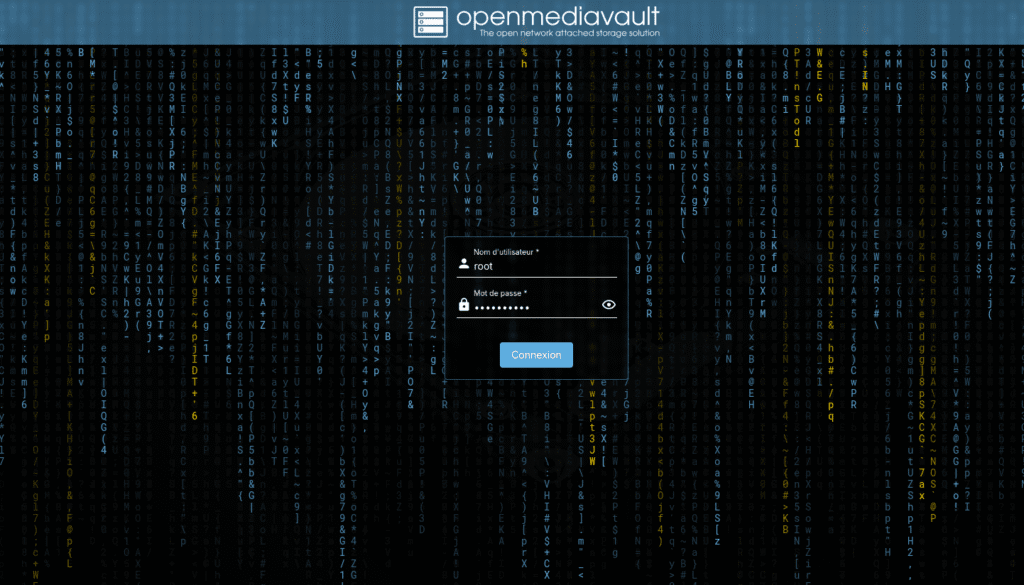

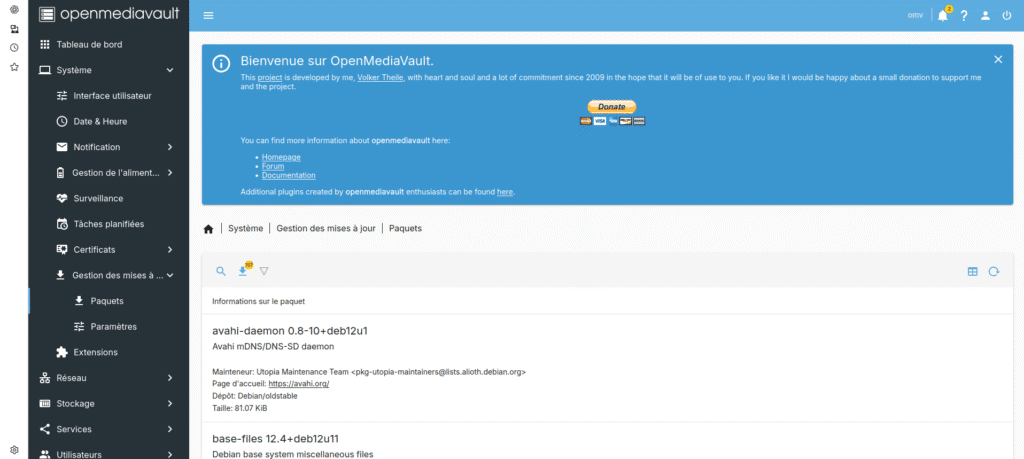

Je vais donc saisir dans ma barre d’adresse 192.168.1.98, l’identifiant et le mot de passe par défaut, c’est admin et openmediavault. On voit qu’on a une interface intuitive, complète et jolie.

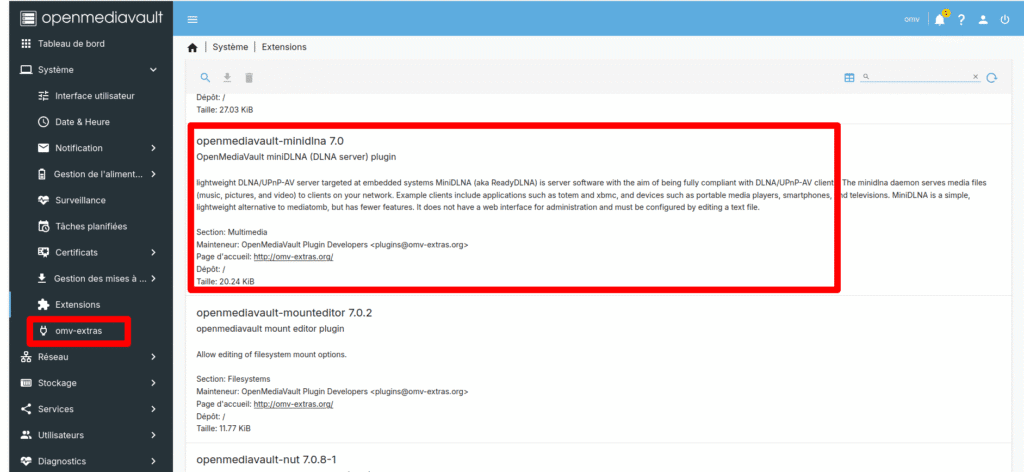

Par défaut les services proposés par OpenMediavault se limitent à la gestion des sauvegardes. On déclare des partages visibles depuis le réseau, du RAID etc… Il est pourtant possible d’aller plus loin avec la distribution à l’aide d’omv-extras. Il s’agit d’un ensemble de plugins qui permettent par exemple de rajouter le serveur MiniDLNA pour visionner des fichiers multimédias dans le réseau.

Afin d’installer les plugins extras, on va faire une connexion SSH de la façon suivante avec le mot de passe qu’on a saisi lors de l’installation de la distribution.

ssh root@192.168.1.98 wget -O - https://github.com/OpenMediaVault-Plugin-Developers/packages/raw/master/install | bashDe retour dans la passerelle, on voit apparaître les OMV extras ainsi qu’un ensemble de nouveaux plugins.

On a donc une solution intéressante pour qui cherche une solution clé en main. S’il y a quelques années, c’est la solution que j’utilisais, ce n’est plus le cas aujourd’hui. D’une part, mon serveur n’est pas une machine avec plusieurs disques durs, mais un mini PC avec un simple SSD à l’intérieur. Je perds donc le sens d’une sauvegarde RAID. De plus je considère que c’est trop restrictif, qu’il n’y a pas assez de liberté notamment dans les services proposés.

Une installation plus personnelle avec Ubuntu Server.

Installation de Nextcloud

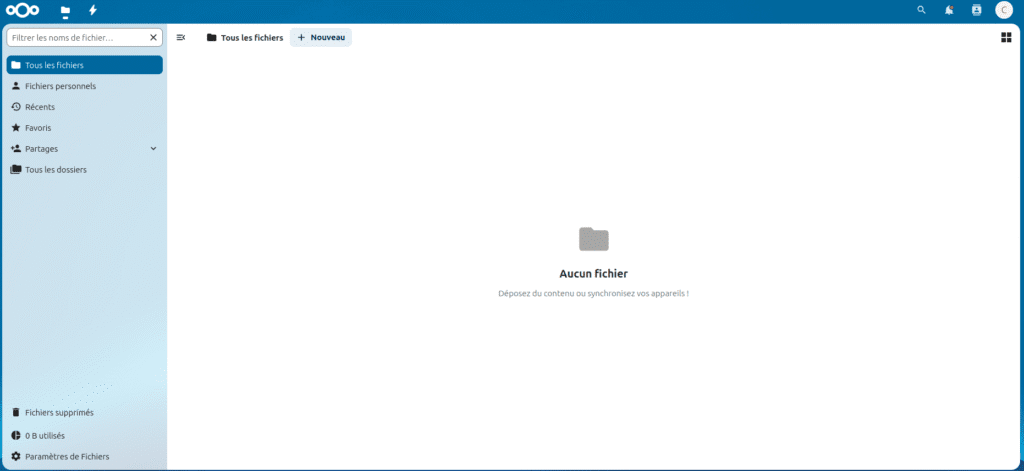

Comme je l’ai écrit assez régulièrement, j’ai fantasmé un Nextcloud personnel en lien avec la fibre optique. Comme je l’ai écrit par la suite, je ne l’ai finalement que très peu utilisé. Il me sert de temps en temps à faire du partage de gros fichiers. C’est trop pour ce que c’est et cela présente très peu d’intérêt. Nextcloud est en effet une solution complète qui permet de s’affranchir de produits Microsoft ou Google. Il est possible de synchroniser son calendrier, ses contacts, et d’ajouter un nombre de plugins conséquents. Nextcloud est une réussite du libre comme LibreOffice ou WordPress.

Je n’ai pas franchi le pas, car le calendrier, les mails ou les contacts, c’est trop sérieux pour tout perdre. Je n’exploite pour ainsi dire, rien de Nextcloud. La machine qui fait office de serveur est un MiniPC d’entreprise dans lequel j’ai mis 1 To de SSD qui traînait et 8 Go de RAM. Le processeur est en gros un core3. La machine a été payée 45€ sur ebay, est particulièrement silencieuse et peu encombrante.

Le choix d’Ubuntu Server est apparu comme une évidence, en effet, Nextcloud dans sa version serveur n’est pas disponible en Flatpak, seulement en Snap. c’est la manière la plus simple d’installer Nextcloud sur un ordinateur. Comme on peut le voir dans l’écran ci-dessous c’est immédiat

Je suis client chez OVH qui gère mes noms de domaine. OVH est intéressant sur plusieurs points notamment les noms de domaine OVH à 3€ et la possibilité d’avoir des domaines avec des DNS dynamiques. Afin de faire le lien entre la machine et le DNS dynamique, il est nécessaire d’installer le logiciel ddclient. Sa configuration est relativement triviale.

Pour vérifier si la configuration fonctionne, il faudra faire : sudo ddclient -daemon=0 -debug -verbose -noquiet. Il faudra ouvrir les ports 80 et 443 avec sudo ufw allow 80,443/tcp. Pour lesquels il sera nécessaire de faire des règles NAT sur la box avec la redirection vers la machine physique.

Par défaut, votre domaine de Nextcloud, c’est l’adresse IP avec laquelle vous avez installé la machine. Ainsi, votre nom de domaine qui pointe désormais vers la machine n’est pas reconnu comme étant de confiance. Il le devient avec la commande ci-dessous.

sudo snap run nextcloud.occ config:system:set trusted_domains 1 –value=mon.joli.domaine (source)

On rajoute enfin un certificat SSL de la façon suivante : sudo nextcloud.enable-https lets-encrypt

Attention à la configuration IPv6, il y a quelques changements à réaliser par rapport à l’IPv4

- Dans le dynhost chez OVH, vous mettez effectivement l’adresse IP de l’appareil,

- Dans la box dans l’IPv6 vous redirigez les ports 80 et 443 sur le serveur,

- Il faut éditer /etc/ddclient.conf et remplacer la ligne qui fait référence à l’IPv4 par use=cmd, cmd=’curl -k -s http://checkip6.spdyn.de’ (source)

Votre Nextcloud est ainsi accessible de l’extérieur avec toutefois quelques limitations si vous êtes en IPv6 à domicile. En effet, impossible si vous êtes en IPv4 de vous connecter à votre serveur. Les mises à jour se font de façon automatique, sans avoir besoin de passer par la ligne de commande.

Installation de MiniDLNA

Le DLNA pour Digital Living Network Alliance est une alliance de constructeur qui a démarré dans les années 2000 et qui promet l’interopérabilité pour les médias. C’est une technologie qui permet concrètement de streamer des contenus multimédias d’un serveur vers différents appareils. Pour vous dire à quel point c’est ancien, on trouvait déjà cette technologie dans les consoles PS3 et XBoX 360. L’intérêt, c’est de centraliser les vidéos sur le serveur et de pouvoir les diffuser sur tous les appareils de la maison. VLC est un client DLNA tout comme les décodeurs pour les télévisions ou même les Smart TV. Le serveur le plus simple à installer c’est MiniDLNA.

Pour toutes les distributions à base de deb :

sudo apt-get install minidlnaPour pouvoir accéder aux répertoires situés dans le home.

sudo adduser minidlna cyrille Le logiciel est installé, il est totalement en ligne de commande et il est transparent. Ce qui veut dire qu’une fois qu’il est installé, vous n’avez plus à vous en préoccuper. Du fait qu’il soit en ligne de commande, il est nécessaire d’éditer le fichier en ligne de commande soit :

sudo nano /etc/minidlna.confIl faudra réaliser les deux manipulations suivantes. Passer inotify à yes de façon à ce que les nouveaux fichiers soient découverts automatiquement. Enfin, déclarer les emplacements dans lesquels vous avez vos fichiers multimédias. Dans mon cas : media_dir=V,/mnt/wwn-0x50014ee2b594a5ce-part1/PARTAGE/Vidéo. Il est bien sûr possible d’avoir une infinité de partages.

Ne prenez pas peur avec le nom barbare de mon partage, c’est le nom du disque externe. On notera le « V » pour préciser qu’il s’agit de Vidéo. On a l’équivalent avec le A de Audio et le P pour Pictures soit les images. Une fois que c’est fait, on démarre le service :

service minidlna startPour démarrer le service au démarrage de l’ordinateur

sudo update-rc.d minidlna defaultsComme on peut le voir, le serveur est visible sur VLC depuis le smartphone et depuis un décodeur SFR.

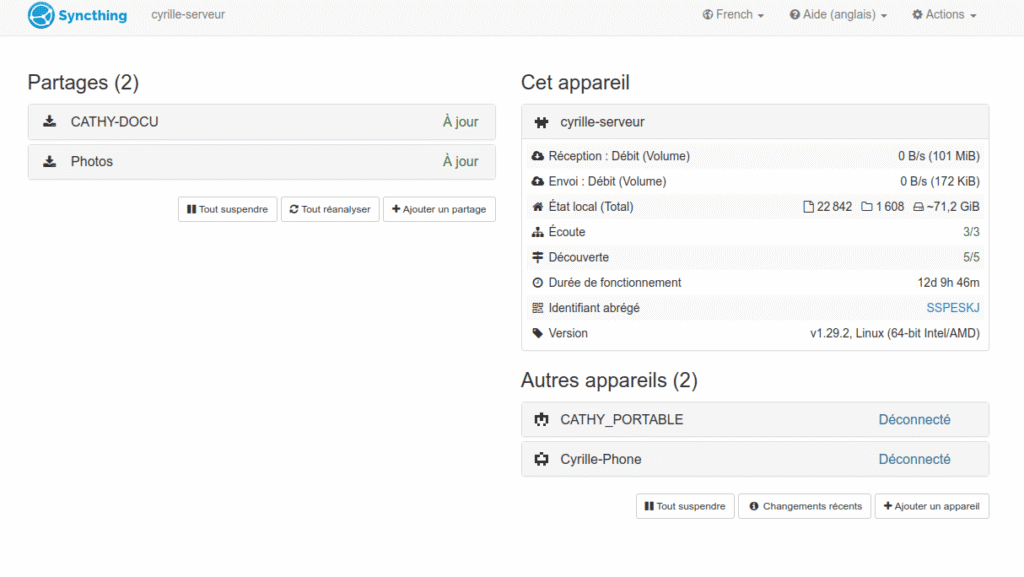

Syncthing bon programme, mauvaise utilisation

Syncthing comme son nom l’indique est un logiciel de synchronisation. La mise en place est extrêmement simple et le logiciel est disponible sur Android, Linux, Windows et Mac. Je ne me suis jamais réellement penché sur les logiciels de sauvegarde que je trouve indigeste et c’est la solution que j’ai trouvée la plus simple même si elle est mauvaise. En effet, c’est un logiciel de synchronisation ce qui sous-entend que si l’appareil émetteur voit ses données effacées et que l’appareil récepteur est allumé alors l’intégralité des données s’efface. De la même manière, une mauvaise manipulation sur l’émetteur et le fichier est définitivement perdu. Dans une véritable sauvegarde incrémentale, il est toujours possible de revenir en arrière.

Le risque reste tout de même acceptable. Un crash qui conduirait à la destruction des fichiers quand l’ordinateur est allumé, c’est peu plausible même sur Windows. L’erreur de manipulation quant à elle est largement plus probable.

En conclusion

S’il fallait retenir quelque chose de ce billet, bien plus que les solutions techniques, c’est que pour moi l’hébergement dans le sens large, c’est un travail de professionnel. Les mails, les sites internet, les contacts, c’est tellement important que je préfère même mieux confier certaines de ces données à des sociétés, même des GAFAM plutôt que de faire les apprentis sorciers. C’était une réflexion que j’avais faite il y a quelques années à propos des smartphones bricolés, notamment l’épopée FirefoxOS, ne pas pouvoir appeler les pompiers ou les urgences parce qu’on a un bug dans la ROM du moment, il y a des limites à la bidouille, la vie en fait partie. À mon niveau de connaissance, d’envie, d’investissement, l’auto-hébergement se résume à un serveur domestique qui peut disparaître du jour au lendemain sans grande conséquence.

Salut,

Je suis pas vraiment d’accord avec ton constat.

Perso j’auto-héberge mes mails (2010), blog (2013), NextCloud (2020) sans trop de soucis.

Mon plus gros soucis était d’avoir une IP «propre», c’est à dire non catégorisé «grand public». avec tous les port ouvert et avec un rDNS configurable. Pendant un temps Free cochait 2 cases sur 3 et puis finalement j’ai pris un VPN chez un FAI associatif local et ça m’a grandement simplifié la vie. Même en cas de coupure internet, je n’avais qu’à déplacer physiquement mon serveur chez un ami et en «plug-n-play» tout revenait.

Yunohost est en effet une bonne solution si on veux pas mettre les main dans le camboui. En ce moment je tourne avec NixOs qui est un niveau intermédiaire de camboui. Mais je suis passé par une Debian et du OpenBSD 😀

Mon autre gros soucis était les défaillances matériel. Connaissant mes besoins très limités, je me basais sur des «board» un peu plus véloce que les Raspberry, mais du même genre. Et Je pense avoir trouvé un bon compromis avec les H2/H3/H4 de chez HardKernel. Ça reste du x86 classique, avec quelques ports SATA (2 / 4) + NVME. compact, passif et pour l’instant très fiable. Depuis 4 ans H24 sans soucis pour mon H2.

Bref, ma première crainte quand je me suis lancé dans l’aventure était la fiabilité de ma connexion, mais au final je n’ai pas besoin de 99,999% de dispo. J’ai déjà vécu 1 semaine sans mail … sans que ce soit dramatique. Là où j’avais très largement sous estimé la charge était la mise en place et l’administration du serveur. J’ai déjà eu des sueurs froides et des nuits bien entamées quand un LVM ne voulait plus se remonter après une coupure d’élec. Mais avec NixOS c’est revenu a un niveau très acceptable (1h par mois). Et puis les presta externe ne sont pas infaillible non plus, regarde l’incendie chez OVH qui a montrer qu’il ne fallait pas faire une confiance aveugle, même avec des sauvegardes. Perso c’est la fin des domaines «.tk» qui m’a le plus perturbé, j’utilisais cette extension pour énormément de mail pour m’inscrire sur des sites.

Commencer par héberger un blog, une instance Nextcloud est un bon début 😉

Pour ma part ce serait très compliqué de ne pas avoir les mails. Pour le reste tu confirmes quand même qu’il s’agit d’un investissement 🙂

Openmediavault ne manque pas de services.

Depuis la version 7, l’équipe a choisi de faire en sorte que ça se déploie en docker plutôt qu’en plugin interne.

Donc si tu veux plus de services, fait monter en compétences.

Après, déjà installer Omv demande de l’investissement personnel en apprentissage.

Salut,

Un peu comme mimoza, j’ai un avis différent du tien : tant que ça ne touche pas aux emails, qui nécessite l’accès au reverse DNS et une bonne réputation, l’auto-hébergement est totalement valide.

Cependant mon blog wordpress n’héberge pas des millions de pages et ne reçoit que peu de requêtes par jour.

De mon côté j’utilise Debian sur un vieux PC (i3, 16Go) derrière une connexion SDSL sans IP fixe (j’ai réglé cette problématique grâce à l’API de gandi et un script maison).

Il est vrai que bossant chez un hébergeur, je suis déjà sensibilisé aux problématiques de sécu et de configuration.

J’adore l’initiative YUNohost mais je préfère savoir ce qu’il se passe sous le capot surtout lorsqu’une machine est exposée sur le net.

Côté sauvegarde, un export chiffré vers un cloud public dans une tâche cron et le tour est joué.

Enfin, des notifications push pour les opérations importantes de ton serveur et le tour est joué.

-mimoza +Mimoza (mes excuses)

Bonjour Cyrille,

dans la configuration des partages Syncthing il y a la possibilité de restreindre le sens de synchronisation, mais aussi et surtout l’activation d’une corbeille avec un délai de rétention pour y récupérer les éléments supprimés.

Je ne savais pas du tout que ça existait. Je vais regarder merci

Bonjour,

D’accord sur certains aspects et moins sur d’autres. Je précise que je m’auto-héberge depuis plus de 15 ans. Mail + Blog compris depuis le début, puis au fil des années un certain nombre de services ouverts sur l’externe. J’ai vu mon infra évoluer au fil du temps, passant d’un serveur mail intégré à un petit NAS à un cluster Proxmox.

Alors oui, il faut toucher à tous les aspects, du matériel au logiciel, du réseau aux applis web, de la virtualisation aux sauvegardes en passant par le parefeu. Ça demande du temps pour être à l’aise avec tout ça et des erreur, j’en ai fait, mais c’est le prix de la liberté et de l’autonomie.

Aujourd’hui, je conseille au gens d’essayer s’ils comprennent (ou veulent comprendre) ce qu’ils font et qu’ils assument le risque. Le risque justement (gravité d’un incident * la probabilité qu’il survienne), ça reste très faible, et je parle d’expérience. Un blog, même très visité, on s’en fiche qu’il ne soit pas disponible 1/2 journée. Pareil pour le mail, avec 2 ou 3 jours d’indisponibilité, ça passe largement. En plus de 15 ans, j’ai eu des coupures, j’ai déménagé plusieurs fois, j’ai des problèmes matériels, des bugs divers et variés, etc… Tout ces problèmes se gèrent (et s’anticipent). Ça implique juste de prendre le temps de mettre les choses en place et de les comprendre.

Bonjour, pour la gestion des emails pendant les coupures, la solution pour ne pas en perdre existe. Il suffit de revenir aux bonnes pratiques des débuts d’Internet : le MX secondaire chez un copain. En passant, si on souhaite renforcer la fiabilité, la même chose peut être pratiquée pour le DNS. À une époque Gandi acceptait d’être secondary (maintenant je ne sais pas). Si vous n’avez personne sous la main on trouve des services gratuits qui le font.

PS : pour les emails il faut partir du principe que l’envoyeur gère mal le renvoi en cas d’échec. Mais si on a confiance, pas besoin de MX secondaire et du coup ça élimine les spam 🤣